AIClient2API 是一个多功能、轻量化的 API 代理,旨在提供极致的灵活性和易用性。它通过一个 Node.js HTTP 服务器,将 Google Gemini CLI 授权登录、OpenAI、Claude、Kiro 等多种后端 API 统一转换为标准的 OpenAI 格式接口。项目采用现代化的模块化架构,支持策略模式和适配器模式,具备完整的测试覆盖和健康检查机制,开箱即用,npm install 后即可直接运行。您只需在配置文件中轻松切换模型服务商,就能让任何兼容 OpenAI 的客户端或应用,通过同一个 API 地址,无缝地使用不同的大模型能力,彻底摆脱为不同服务维护多套配置和处理接口不兼容问题的烦恼。

核心优势

- 多模型统一接入:一个接口,通吃 Gemini、OpenAI、Claude、Kimi K2、GLM-4.5 等多种最新模型。通过简单的启动参数或请求头,即可在不同模型服务商之间自由切换。

- 突破官方限制:通过支持 Gemini CLI 的 OAuth 授权方式,有效绕过官方免费 API 的速率和配额限制,让您享受更高的请求额度和使用频率。

- 突破客户端限制:Kiro API 模式下支持免费使用Claude Sonnet 4 模型。

- 无缝兼容 OpenAI:提供与 OpenAI API 完全兼容的接口,让您现有的工具链和客户端(如 LobeChat, NextChat 等)可以零成本接入所有支持的模型。

- 增强的可控性:通过强大的日志功能,可以捕获并记录所有请求的提示词(Prompts),便于审计、调试和构建私有数据集。

- 极易扩展:得益于全新的模块化和策略模式设计,添加一个新的模型服务商变得前所未有的简单。

- 完整测试覆盖:提供全面的集成测试和单元测试,确保各个API端点和功能的稳定性和可靠性。

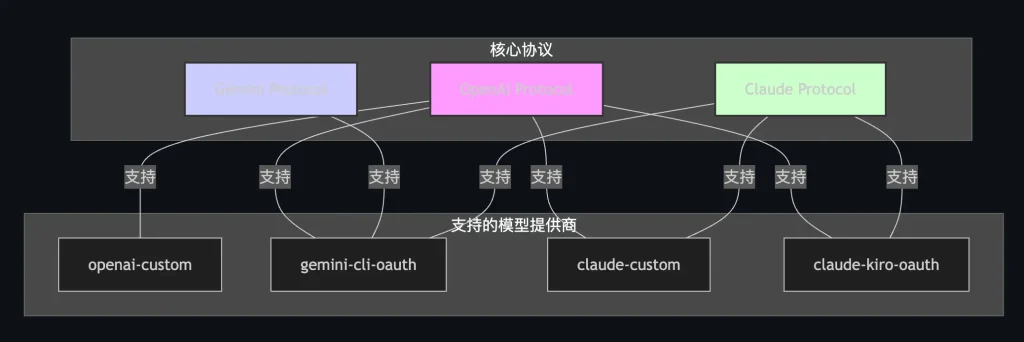

模型协议与提供商关系图

- OpenAI 协议 (P_OPENAI): 支持所有 MODEL_PROVIDER,包括 openai-custom、gemini-cli-oauth、claude-custom 和 claude-kiro-oauth。

- Claude 协议 (P_CLAUDE): 支持 claude-custom、claude-kiro-oauth 和 gemini-cli-oauth。

- Gemini 协议 (P_GEMINI): 支持 gemini-cli-oauth。

使用说明

- MCP 支持: 虽然原版 Gemini CLI 的内置命令功能不可用,但本项目完美支持 MCP (Model Context Protocol),可配合支持 MCP 的客户端实现更强大的功能扩展。

- 多模态能力: 支持图片、文档等多模态输入,为您提供更丰富的交互体验。

- 最新模型支持: 支持最新的 Kimi K2 和 GLM-4.5 模型,只需在

config.json中配置相应的 OpenAI 或 Claude 兼容接口即可使用。 - Kiro API: 使用 Kiro API 需要下载kiro客户端并完成授权登录生成 kiro-auth-token.json。推荐配合 Claude Code 使用以获得最佳体验。注意:新注册的用户,如果使用时报429,表示已不可使用 Kiro 的服务,可能需要等Kiro完全开放注册后,才能使用。

特殊用法与进阶技巧

- 对接任意 OpenAI 客户端: 这是本项目的基本功能。将任何支持 OpenAI 的应用(如 LobeChat, NextChat, VS Code 插件等)的 API 地址指向本服务 (

http://localhost:3000),即可无缝使用所有已配置的模型。 - 中心化请求监控与审计: 在

config.json中设置"PROMPT_LOG_MODE": "file"来捕获所有请求和响应,并保存到本地日志文件。这对于分析、调试和优化提示词,甚至构建私有数据集都至关重要。 - 动态系统提示词:

- 通过在

config.json中设置SYSTEM_PROMPT_FILE_PATH和SYSTEM_PROMPT_MODE,您可以更灵活地控制系统提示词的行为。 - 支持的模式:

override: 完全忽略客户端的系统提示词,强制使用文件中的内容。append: 在客户端系统提示词的末尾追加文件中的内容,实现规则的补充。

- 这使得您可以为不同的客户端设置统一的基础指令,同时允许单个应用进行个性化扩展。

- 通过在

- 作为二次开发基石:

- 添加新模型: 只需在

src目录下创建一个新的提供商目录,实现ApiServiceAdapter接口和相应的策略,然后在adapter.js和common.js中注册即可。 - 响应缓存: 对高频重复问题添加缓存逻辑,降低 API 调用,提升响应速度。

- 自定义内容过滤: 在请求发送或返回前增加关键词过滤或内容审查逻辑,满足合规要求。

- 添加新模型: 只需在

立即体验:

🔗 GitHub地址:https://github.com/justlovemaki/AIClient-2-API

📚 完整文档:项目Wiki